Nous avons vu dans la première partie de l’article les risques que présentent les deepfakes pour les entreprises. Dans cette partie, nous allons traiter des stratégies pour s’en prémunir et des actions concrètes à mettre en place dès maintenant pour réduire les risques que présentent les deepfakes.

Différentes stratégies pour se prémunir des deepfakes

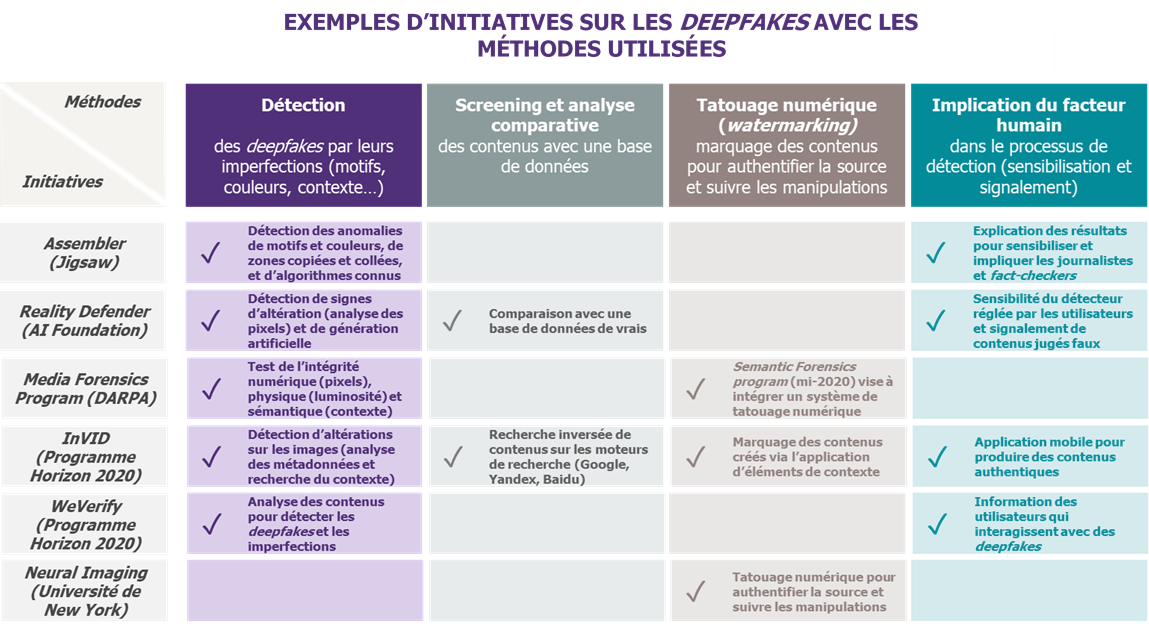

En parallèle du cadre légal, les organisations publiques et privées s’organisent pour proposer des solutions permettant de détecter et d’empêcher la diffusion malveillante de deepfakes. On peut distinguer quatre stratégies pour s’en prémunir.

1/ La détection d’imperfections

Détecter les deepfakes par leurs imperfections est l’une des principales méthodes existantes. Certaines irrégularités restent présentes dans les contenus générés, comme le manque de clignements des yeux et de synchronisation entre les lèvres et la voix, les distorsions du visage et des accessoires (branches de lunettes), ou encore l’inexactitude du contexte (météo, localisation).

Les deepfakes sont cependant construits pour apprendre de leurs erreurs et générer un contenu de plus en plus proche de l’original, rendant les imperfections moins perceptibles. Les outils utilisant cette stratégie de détection des deepfakes peuvent être efficaces mais nécessitent d’être sans cesse améliorés pour détecter des anomalies de plus en plus légères.

On peut citer dans cette catégorie de protection Assembler, un outil à destination des journalistes développé par Jigsaw (branche d’Alphabet, maison-mère de Google). Il permet de vérifier l’authenticité des contenus en les analysant via cinq détecteurs dont les anomalies de motifs et de couleurs, les zones copiées et collées, et les caractéristiques connues d’algorithmes de deepfakes.

2/ Le screening et l’analyse comparative

Comparer les contenus à une base de données de vrais ou en cherchant des contenus similaires sur les moteurs de recherche pour voir s’ils n’ont pas été manipulés (par exemple, en trouvant la même vidéo avec un visage différent) est une autre stratégie permettant de se prémunir des deepfakes.

En 2020, la AI Foundation devrait rendre disponible un plug-in, Reality Defender, à intégrer aux navigateurs et à insérer à terme aux réseaux sociaux. Celui-ci permettra de détecter les manipulations des contenus, ciblant dans un premier temps les politiciens. Les utilisateurs seront amenés à régler la sensibilité de cet outil, selon les manipulations qu’ils voudront détecter ou non pour ne pas être notifiés à chaque manipulations de média, notamment pour les manipulations les plus courantes (retouches d’une photo de la page Web faite sur Photoshop par exemple).

3/ Le tatouage numérique (watermarking)

Une troisième méthode consiste à marquer les contenus d’un tatouage numérique pour faciliter le processus d’authentification en en renseignant la source et en suivant les manipulations réalisées sur ces contenus.

Une équipe de l’Université de New York travaille sur un projet de recherche de création d’un appareil photo embarquant une technologie de watermarking destinée à marquer les contenus photographiés, afin non seulement d’authentifier la photographie d’origine, mais aussi de marquer et suivre toutes les modifications opérées sur la photographie pendant son cycle de vie.

4/ L’implication du facteur humain

Impliquer les utilisateurs dans le processus de détection permet à la fois de mitiger les impacts des deepfakes en faisant prendre conscience que l’altération des contenus accédés est possible, et de réduire leur occurrence en leur permettant de reporter leurs suspicions de deepfakes.

Le plugin Reality Defender déjà évoqué offrira la possibilité aux utilisateurs de signaler les contenus qu’ils jugent faux pour en informer les autres utilisateurs – qui en plus de l’analyse réalisée par l’outil verront si les contenus ont été signalés par d’autres utilisateurs, offrant un second niveau de signalisation.

Des initiatives portées par des coopérations d’acteurs multisectoriels combinent ces quatre stratégies pour une efficacité maximale contre les deepfakes. Certaines sont déjà utilisées ou testées par des journalistes. C’est le cas de InVID, initiative développée dans le cadre du programme de l’Union Européenne Horizon 2020 de financement de la recherche et de l’innovation, utilisé par l’Agence France-Presse.

Des solutions et stratégies émergent donc, le marché se construit, et de nouvelles solutions innovantes devraient apparaitre très prochainement avec les résultats du Deepfake Detection Challenge. Ce concours anti-deepfake a été lancé par Facebook à l’approche des élections présidentielles américaines, et plus de 2600 équipes s’y sont inscrites. Résultats le 22 avril !

Ci-dessous un tableau présentant des exemples d’initiatives combinant différentes stratégies pour se prémunir des deepfakes.

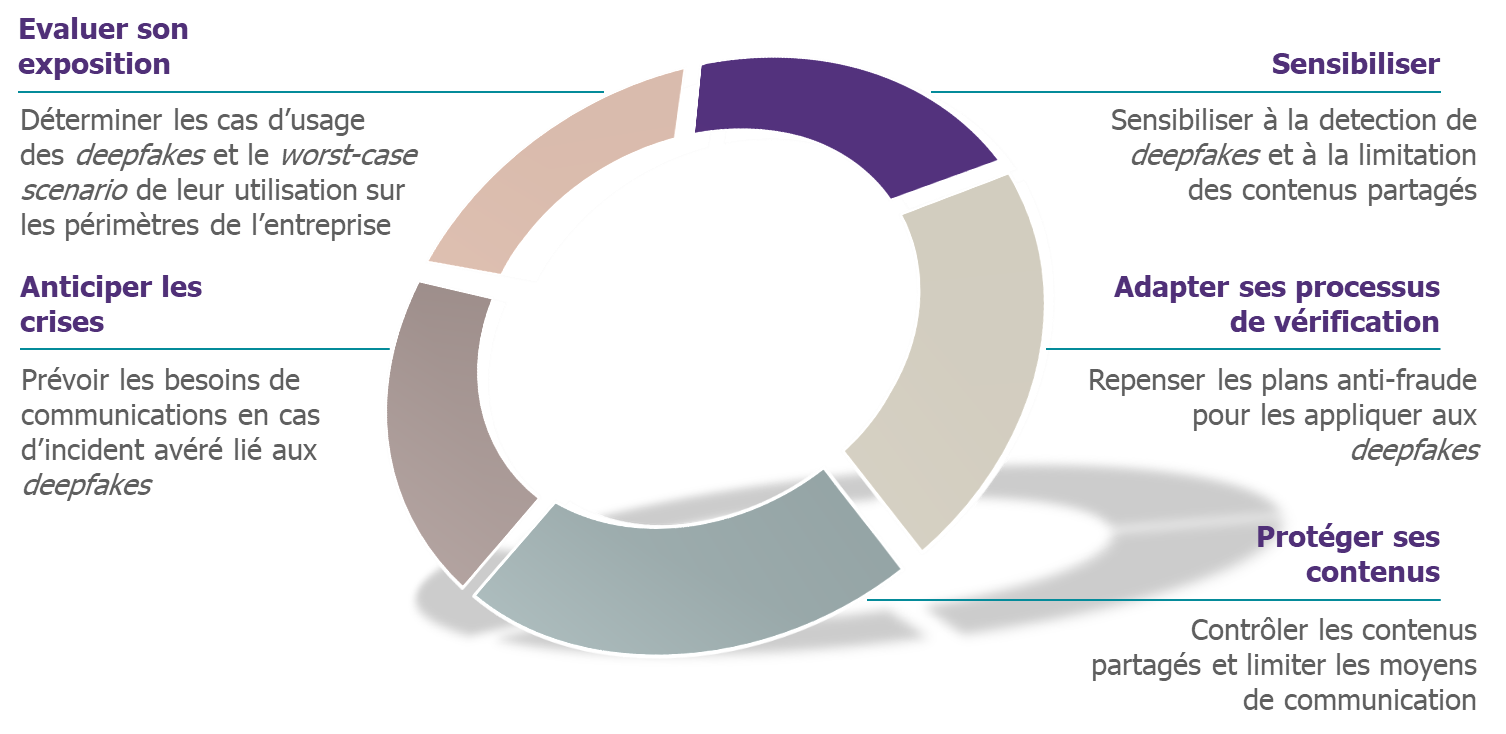

Différents moyens pour protéger son activité

Le risque présenté par les deepfakes pour les entreprises est bien réel et voici quelques actions clés à lancer pour s’en protéger et mitiger ses impacts dès maintenant.

- Evaluer son exposition : Les cas d’usage des deepfakes et le worst-case scenario de leur utilisation doivent être déterminés sur les périmètres de l’entreprise, en considérant les risques de fraude et de déstabilisation, et en identifiant la ou les stratégies de sécurité adaptées.

- Sensibiliser : Les collaborateurs doivent être sensibilisés à la détection des deepfakes (pour éviter les cas de fraudes) mais aussi à la limitation des contenus partagés sur les réseaux sociaux pouvant être réutilisés pour produire des deepfakes (pour éviter la déstabilisation). A l’image des campagnes de faux phishing, cette sensibilisation porte à la fois sur la détection des défauts techniques (forme) des deepfakes (bien qu’elles seront amenées à disparaître avec le perfectionnement des techniques), mais surtout sur la détection du caractère suspect des informations (fond), invitant à la méfiance, au recoupement des informations et à la notification de suspicions aux équipes compétentes (que faire si je vois une vidéo suspecte de mon responsable communication sur les réseaux sociaux pendant le week-end ? Que faire si je reçois un message vocal de mon chef me demandant de réaliser une opération ponctuelle un peu hors de mon périmètre ?).

- Adapter ses processus de vérification : Les plans anti-fraude existants peuvent être repensés pour s’appliquer aux deepfakes. Par exemple, pour une fraude au président via deepfakes, une des recommandations est de proposer à son interlocuteur de raccrocher et le rappeler (si possible sur un numéro déjà connu, et après des vérifications internes). Pour les scénarios de fraudes les plus sensibles, ces processus de réactions doivent être définis très finement et les collaborateurs concernés régulièrement formés aux réflexes à adopter. Des outils tels que définis précédemment peuvent également être utilisés pour vérifier tout ou partie des médias consommés par les collaborateurs.

- Protéger ses contenus : Les contenus représentant des collaborateurs partagés en interne et en externe par l’entreprise peuvent être contrôlés pour éviter qu’ils ne soient réutilisés pour produire des deepfakes. Les entreprises peuvent limiter la diversité des données potentiellement utilisables par des personnes malintentionnées (angles de vues des personnes et types de médias) et jouer sur la qualité numérique (définition) des contenus partagés. En effet, plus les attaquants bénéficient de contenus divers et de bonne qualité représentant des collaborateurs, plus il est facile de les réutiliser pour générer des deepfakes. De plus, les entreprises peuvent limiter leurs moyens de communication à une chaine officielle, des réseaux sociaux vérifiés et leurs sites web officiels – ce qui crée des habitudes de consommation de contenus par l’audience, qui verra sa méfiance éveillée par toute diffusion sortant de ces habitudes.

- Anticiper les crises : Les besoins de communications en cas d’incident avéré lié aux deepfakes doivent être prévus, et la gestion du cas du deepfake doit intégrer les scénarios de communications « génériques » adressés dans les plans de communication de crise.